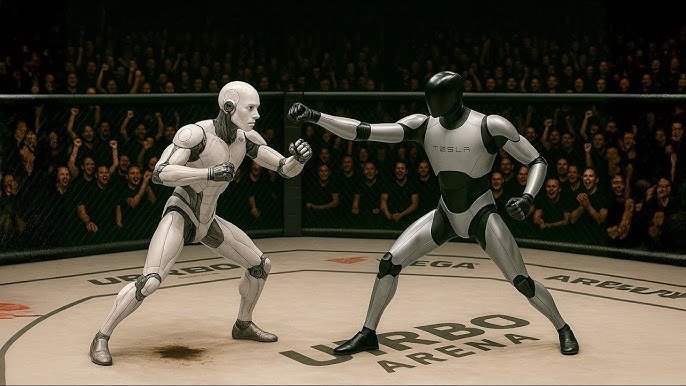

Un nou conflict aprins în domeniul inteligenței artificiale a ieșit la iveală, în centrul căruia se află acuzații grave de practici frauduloase între companii tehnologice globale. În timp ce industria AI se află în plină expansiune și concurență acerbă, un lucru începe să devină clar: metodele neortodoxe pentru a accelera și amplifica performanța modelelor devin tot mai frecvent utilizate, pentru a câștiga avantaje competitive.

Acuzații de furt intelectual și utilizare ilegală a modelelui Claude

Compania americană Anthropic, creatorul modelului de inteligență artificială Claude, dă publicului imaginea unui scenariu îngrijorător. Potrivit acesteia, mai multe entități din China, printre care și DeepSeek, ar fi utilizat modelul Claude pentru a-și îmbunătăți propriile sisteme AI, printr-un proces cunoscut ca „distilare”. Aceasta presupune crearea unor copii „mai mici” și mai rapizi ai unui model preexistent, obținând astfel anumite capabilități specifice fără a fi nevoie să dezvolte în mod independent și costisitor întreg sistemul.

În cazul acestor companii, se presupune că au fost create aproximativ 24.000 de conturi false, care au generat peste 16 milioane de interacțiuni cu Claude. Scopul principal? Extragerea mecanismelor avansate de raționament ale modelului, pentru a le transfera și integra în propriile sisteme AI. Potrivit celor de la Anthropic, aceste practici au fost desfășurate la scară industrială, cu un focus accentuat pe abilitatea lui Claude de a raționa și de a procesa informații complexe.

Distilarea AI — de la metodă legitimă la potențial abuz

Departe de a fi o tehnică exclusiv ilegală, distilarea este în esență o metodă folosită pe scară largă în domeniul AI pentru a optimiza și a accelera operațiunile. Ea constă în antrenarea unor modele mai mici, bazate pe rezultatele obținute de modele mult mai potente și mai complexe, pentru a crea versiuni mai rapide și mai eficiente. Aceasta a permis dezvoltarea de sisteme de rapiditate și eficiență remarcabilă, fără a compromite acuratețea.

Însă, compania Anthropic atrage atenția și asupra riscurilor de utilizare abuzivă a acestei metode. În loc să dezvolte și să-și îmbunătățească propriile sisteme de la zero, unele companii pot alege să utilizeze interacțiuni masive cu modele avansate pentru a le replica și a-i „fura” performanțele, într-un timp mult mai scurt și cu costuri mai reduse. În cazul DeepSeek, se pare că au fost înregistrate peste 150.000 de conversații cu Claude, cu scopul de a extrage mecanismele de raționament ale modelului.

Mai mult, Anthropic susține că aceste modele „distilate” ar fi fost manipulate pentru a genera versiuni „sigure din punct de vedere al cenzurii” pentru întrebări sensibile din punct de vedere politic, precum cele care vizează disidenți, lideri de partid sau regimuri autoritare. Astfel, aceste practici riscă să compromită atât integritatea sistemelor AI, cât și siguranța publică, dincolo de zonele de jocuri de cuvinte tehnice.

Tensiuni geopolitice și apeluri la restricții

Contextul devine și mai complicat atunci când această dispută se intersectează cu tensiunile geopolitice existente. Uniunea Tibetului și a forumurilor de securitate cibernetică din SUA încearcă să țină pasul cu riscurile generate de aceste practici. Într-un recent mesaj adresat legislatorilor americani, reprezentanți ai OpenAI au acuzat DeepSeek de încercări de a „beneficia gratuit” de cercetarea realizată de laboratoarele AI din SUA.

Anthropic face apel la o acțiune coordonată în industrie, politicieni și specialiști pentru a preveni răspândirea acestor practici. În viziunea companiei, soluția ar putea fi limitarea accesului la cipuri și tehnologii avansate, pentru a controla dezvoltarea de modele de dimensiuni mari și pentru a evita ca acestea să fie utilizate în scopuri neautorizate sau periculoase, inclusiv în infrastructuri militare sau de supraveghere.

Pe măsură ce parcurgem ultimele luni, evoluția acestei situații pare să indice o nevoie acută de reglementare și control, pentru a evita ca senzația de inovație neîngrădită să se transforme în o amenințare reală la adresa siguranței globale. Cu toate eforturile din ce în ce mai accentuate ale actorilor industriali și legislativi, viitorul AI-ului depinde de capacitatea de a institui norme ferme pentru a preveni orice abuz în fața unor tehnologii atât de puternice și, totodată, atât de periculoase dacă sunt manipulate în mod necorespunzător.